Je website staat online, je pagina’s zien er netjes uit, maar in Google duikt er niets op. Herkenbaar? Ik krijg deze vraag met de regelmaat van de klok. En negen van de tien keer zit de oorzaak in één van deze vier dingen.

Eerst checken: niet geïndexeerd of gewoon laag?

Voordat je conclusies trekt, moet je weten waar je precies mee te maken hebt. Er zijn grofweg twee scenario’s waarom je pagina onvindbaar voelt:

- Je pagina staat wél in de index, maar op plek 482 voor je doelzoekwoord. Dan is het een rankingprobleem, geen indexatieprobleem.

- Je pagina staat helemaal niet in de index. Dát is wat we hieronder oplossen.

Twee snelle manieren om te checken in welke situatie je zit:

Methode 1, site-operator. Type in Google: site:jouwdomein.nl. Je krijgt dan ruwweg een overzicht van wat Google geïndexeerd heeft. Staat de pagina er niet tussen? Indexatieprobleem.

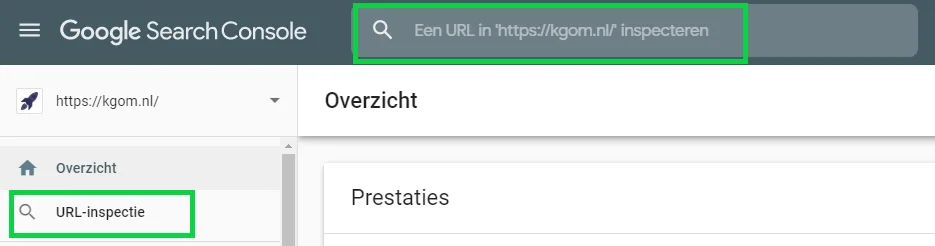

Methode 2 (beter), Google Search Console. Open Search Console, plak je URL bovenin in de zoekbalk en je krijgt exact te zien of, wanneer en hoe Google je pagina heeft opgepakt.

Zie je een resultaat zoals hieronder? Dan is er werk aan de winkel ;-)

Reden 1. Google heeft je pagina nog niet gevonden

Zeker bij een gloednieuwe site komt dit voor. Google is tegenwoordig best rap, maar het is geen garantie. Als je pagina nergens aan gelinkt is, kan het prima een paar weken duren voordat de crawler hem oppikt.

Oplossing

De meest natuurlijke manier: laat een pagina op een andere (goed bezochte) website naar je site linken. Google volgt die link en ontdekt je site en alles eromheen.

De snelle route: gebruik in Search Console “Indexering aanvragen” na de URL-inspectie. Goed voor één of twee belangrijke pagina’s. Upload daarnaast een sitemap.xml via Search Console, dat is je structurele oplossing.

Eén waarschuwing: als je website al een tijd loopt en een pagina wordt nog steeds niet geïndexeerd, dan wil je eerst de oorzaak weten vóór je indexering forceert. Anders maskeer je een dieper probleem. Verbroken interne links zijn daar typisch een voorbeeld van.

Reden 2. Google komt niet bij je pagina via interne links

Google ziet wel je homepage, maar niet de pagina’s die dieper in je site zitten. Dan heb je een crawl-navigatieprobleem. De crawler volgt interne links (menu, footer, contextueel in de body) en als een pagina nergens vanaf gelinkt wordt, bestaat hij voor Google eigenlijk niet.

Oplossing

Check je navigatiestructuur. Belangrijke pagina’s verdienen een link vanaf je homepage of een hoofdcategorie. Pagina’s die drie of vier klikken diep zitten, krijgen nauwelijks crawl-prioriteit.

De logica van Google is eigenlijk heel simpel: als een pagina bijna geen interne links krijgt, zal hij ook wel niet zo belangrijk zijn. Anders had je hem toch wel gelinkt? In hoe je interne links inzet om bestaande pagina’s te versterken ga ik daar dieper op in.

Reden 3. Je verbiedt Google om je pagina’s te indexeren

Klinkt als een open deur, maar ik kom het echt wekelijks tegen. In je robots.txt of in de pagina’s zelf (via de meta-robots-tag met noindex) kun je Google expliciet vragen om een pagina niet op te nemen.

Belangrijkste boosdoener: een redesign of migratie waarbij de webbouwer tijdelijk noindex op de stagingsite had staan. Gaat de site live, en wordt de tag vergeten te verwijderen? Game over voor je rankings.

Oplossing

Check drie plekken:

- Je robots.txt. Staat er een Disallow: /? Dan blokkeer je al je pagina’s voor crawlen.

- De meta-tag in je HTML. Kijk in de broncode naar . Staat die er? Weghalen.

- De X-Robots-Tag in je HTTP-headers. Vaak over het hoofd gezien. Check met de URL-inspectie in Search Console.

Kleine noot: Google ondersteunt de noindex-regel in robots.txt al een tijdje niet meer. De meta-tag of HTTP-header is de juiste plek.

Reden 4. Duplicate content

Stel je hebt een webshop met 1.000 producten en dus 1.000 productpagina’s. Als de teksten voor 80% identiek zijn (zelfde template, zelfde generieke productomschrijving), gaat Google op een gegeven moment kiezen. “Waarom zou ik al deze pagina’s tonen, ze zijn toch hetzelfde?” Resultaat: één of twee varianten komen door de indexatie, de rest sneuvelt.

Oplossing

Zorg dat elke pagina genoeg unieke inhoud heeft. Bij productpagina’s: unieke omschrijving, unieke USP’s, unieke FAQ-sectie. Bij categoriepagina’s: contextuele intro die uniek is per categorie. Zie de handleiding over duplicate content voor de volledige aanpak.

Heb je te maken met pagina’s die in de buurt van elkaar zitten qua onderwerp? Dan is content-kannibalisatie vaak de daadwerkelijke oorzaak, en dat pak je anders aan dan pure duplicate content.

En als geen van deze vier het is?

Dan kijk ik doorgaans richting een handmatige penalty (zeldzaam tegenwoordig, maar bestaat nog steeds voor spammy linkbuilding of gegenereerde content) of een veel dieper technisch issue zoals een JavaScript-rendering-probleem waardoor Google je daadwerkelijke content niet ziet. Beide zijn te checken via de URL-inspectie in Search Console: kijk bij “Geteste pagina” of Google dezelfde content ziet als jij.

Wil je structureel weten of een daling in zichtbaarheid door content, techniek of verminderde zoekvraag komt? Dat heb ik uitgewerkt in hoe je een SEO-verkeerdaling ontleedt.